“Tenemos que desarrollar la capacidad para distinguir dónde hay conciencia y dónde no”, indicó Leonardo Ruíz, profesor de filosofía de la Universidad Panamericana.

Todos hemos visto series y películas futuristas en las que se representa de maneras tal vez no muy irreales el futuro de la humanidad, pues en ellas se muestra una civilización enajenada en la tecnología,llena de carros voladores y robots en todas partes.

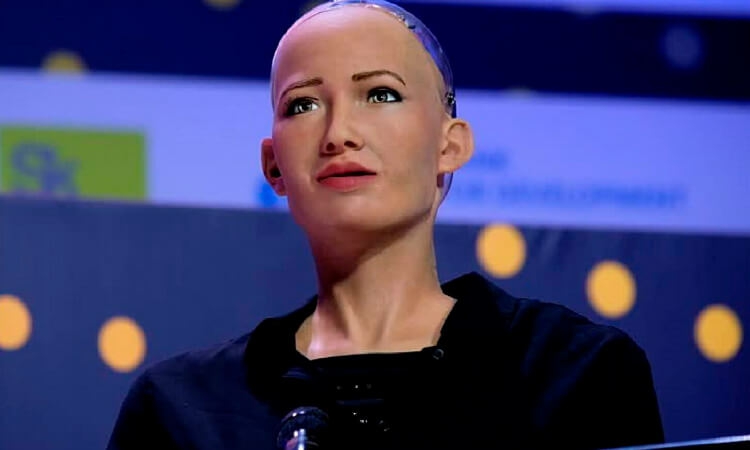

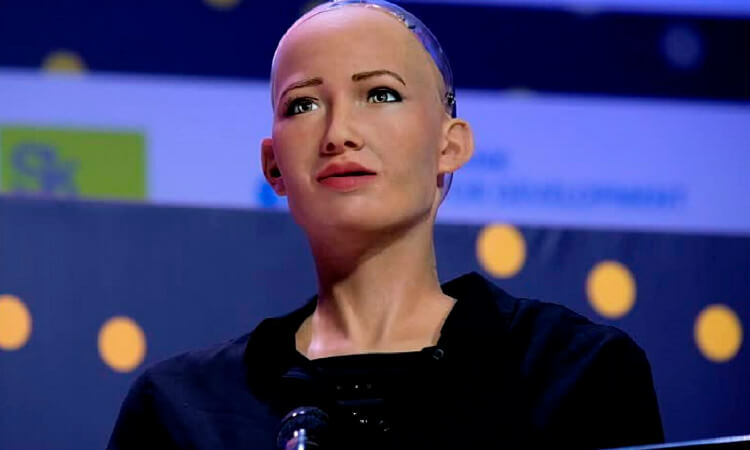

Y aunque en pleno 2019 no vemos precisamente carros voladores sí tenemos ya a Sophia, el primer humanoide creado por la compañía Hanson Robotics, capaz de mantener conversaciones por sí sola, de reconocer personas, puede imitar emociones y tiene un rostro hecho de silicona, con facciones y movimientos iguales a las de un ser humano.

Sophia fue activada el 19 de abril de 2015 y desde entonces su popularidad no ha hecho más que ir en aumento, se ha presentado en todo tipo de programas televisivos y en 2017 se le concedió la nacionalidad de Arabia Saudita, causando indignación pues contrario al robot Sophia, el resto de mujeres de ese país tienen sus derechos limitados.

En julio, Sophia fue invitada a El Hormiguero, popular programa español, durante la entrevista Pablo Motos, conductor del programa, pregunta al humanoide “¿Tú eres una máquina?” y la respuesta fue: “Sí, soy un robot, soy un tipo de máquina… pero con el tiempo la distinción entre vida y máquina comenzará a desdibujarse”.

La humanoide ha causado gran polémica, pues en más de una ocasión ha bromeado con destruir a los humanos o controlar a la humanidad. Ante esas declaraciones la sociedad se ha dividido y hay quienes aseguran que es una simple broma y otros comentan que es una posibilidad totalmente posible, debido a que la capacidad de aprendizaje de la humanoide es infinita.

Diversas personas han asegurado que Sophia rompe con las Leyes de la Robótica, creadas por Isaac Asimov con el fin de establecer límites entre la tecnología y la humanidad, pues desde hace años supo que el ser humano sería capaz de alcanzar desarrollos tecnológicos inimaginables.

En primer lugar, un robot no puede hacer daño a un ser humano o por inacción, permitir que un ser humano sufra daño; después, un robot debe obedecer las órdenes dadas por los seres humanos, excepto las que violen la primera ley, y al final un robot debe proteger su propia existencia en la medida en que su protección no ponga en riesgo el cumplimiento de la primera y la segunda ley.

El peligro no es Sophia, somos nosotros mismos

Leonardo Ruíz Gómez, docente e investigador de filosofía en la Universidad Panamericana (UP), comentó que el reto entre humanos y robots es lograr que las personas distingan que tiene consciencia y qué no la tiene. Ruíz Gómez explicó que la conciencia moral es la capacidad para discernir entre el bien y el mal en una acción, y la cognitiva es un estado en segundo grado del pensamiento, y nos permite no sólo pensar, también darnos cuenta de que podemos hacerlo.

El filósofo comentó que a un robot le puedes poner cámaras y sensores, que funcionan casi como un ojo; sin embargo, lo que es dudoso es si tienen la consciencia de que piensan o sienten, “eso es lo que nos distingue de los robots, pues nosotros tenemos consciencia de lo que sucede”, recalcó Leonardo Ruíz.

Y el filósofo puso como ejemplo el experimento de la caja china del filósofo John Searle, que consistió en meter a una persona en una caja con dos rendijas una de entrada y otra de salida, la persona no sabía leer ni escribir en chino y se le daban unas instrucciones en ese idioma junto con un manual que le explicaba el significado de ciertos símbolos en chino, de esa manera quien estaba en la caja podía traducir el chino.

Ruíz Gómez explicó que en la caja china se mete un input (código de entrada) y sale un output (código de salida o respuesta), entonces parece que la persona sabe chino, pero cuando lo analizas no es así, lo único que la persona sabe es transformar signos o aplicar ciertos algoritmos. “Lo mismo pasa con los robots, les hacemos una pregunta y nos dan una respuesta, vemos que cada vez replican de una manera más perfecta las respuestas de los seres humanos”, comentó el profesor.

“Una cosa es que ellos repliquen nuestras respuestas y otra es que ellos tengan consciencia de lo que hacen, tenemos que desarrollar la capacidad para distinguir dónde hay consciencia y dónde no”, indicó Leonardo Ruíz y subrayó que cuando vemos a alguien hablando con Sophia enseguida atribuimos cualidades humanas a la máquina, cuando sólo es una máquina, y afirmó que “eso no es un problema del robot, es un problema de los humanos”.

Finalmente, el filósofo explicó que en ocasiones nuestra necesidad de generar empatía y de sentirnos escuchados es tanta que tendemos a atribuir consciencia a cosas que no las tienen, por lo que “más que cuidarnos de los robots tenemos que cuidarnos de nosotros mismos”.

Te puede interesar: Los videojuegos ponen en riesgo la salud